NVIDIA : JARVIS, IA, SoC, voiture autonome

mer, 14/04/2021 - 15:29

NVIDIA, bien connu pour les GPU, a annoncé toute une série de nouveaux processeurs et de plateformes dédiées, certaines annonces ne seront concrètes que dans 2-3 ans. Une des ambitions du fondeur est la voiture autonome où il faut de l’intelligence et une forte capacité de traitement local et de la connectivité. NVIDIA a dévoilé Drive Atlan pour les plates-formes de voitures autonomes. L’objectif est de proposer une unique puce, ou SoC. Atlan ne sera pas disponible avant plusieurs années, mais NVIDIA marque dès maintenant le territoire. Au-delà du SoC, il y a toute la couche logicielle à développer. Ce SoC doit permettre de traiter, de gérer et de stocker les données du véhicule. Avant Atlan, prévu pour 2023 - 2025, NVIDIA sortira Drive Orin, sans doute dès 2022.

Autre annonce : Omniverse Enterprise. Cette plate-forme est dédiée à la simulation et conception collaborative. Elle vise les entreprises, les équipes 3D. Cette offre comprend les matériels, les connecteurs nécessaires pour supporter les solutions du marché. Omniverse fonctionne avec les plateformes matérielles hautes performances du constructeur : les RTX et surtout les EGX.

NVIDIA s’attaque aussi aux assistants virtuels, aux bots intelligents avec Jarvis Interactive Conversational AI Framework. Jarvis est une plate-forme pré-entrainée de Deep Learning. Elle embarque les outils pour créer les services conversationnels. Jarvis supporte la reconnaissance vocale, la traduction à la volée et la synthèse vocale. Jarvis repose notamment sur NVIDIA TAO, un framework pour entraîner et optimiser les modèles selon le marché, l’usage. NVIDIA veut aussi simplifier l’usage de ces fonctionnalités via des API et des SDK pour aider les développeurs. Il s’agit de pouvoir implémenter les clients Jarvis des apps mobiles / desktop aux services Jarvis côté serveur.

NVIDIA propose une architecture très complète pour pouvoir traiter la voix, les textes, générer les modèles. Le lien entre le front et le back se fait par des requêtes et des réponses gRPC. Python est un des langages conseillés. Jarvis est disponible en préversion.

Pour en savoir plus sur Jarvis : developer.NVIDIA.com/blog/introducing-jarvis-framework-for-gpu-accelerated-conversational-ai-apps

Autre (très grosse) nouveauté du constructeur : le DGX SuperPOD. Là, le constructeur s’attaque au marché HPC, aux calculateurs scientifiques. NVIDIA le positionne en supercalculateur cloud computing, HPC, traitement IA. Comme pour les générations précédentes, il y a le hardware et surtout toutes les couches logicielles pour optimiser les applications et les usages pour exploiter les différentes puces NVIDIA.

Le superpod est un monstre de puissance : jusqu’à 700 Pflops, de 20 à 140 systèmes A100 DGX, stockage jusqu’à 10 Po, réseau ultra haute vitesse (jusqu’à 200 Gb/s). Bien entendu, aucun tarif public.

Autre annonce du constructeur : la future puce Grace. Elle se dédie là encore à l’IA, aux traitements des flux. Grace repose sur une architecture ARM et l’ambition du constructeur est à la hauteur des ambitions autour d’ARM : des performances jusqu’à x10 par rapport aux puces serveurs actuelles. Effet d’annonce pour le moment, car Grace ne devrait pas être disponible avant 2023 et beaucoup de choses peuvent évoluer. Mais Grace se situe dans un marché serveur / datacenter de niche, pas question d’aller affronter AMD et Intel, du moins, pas encore.

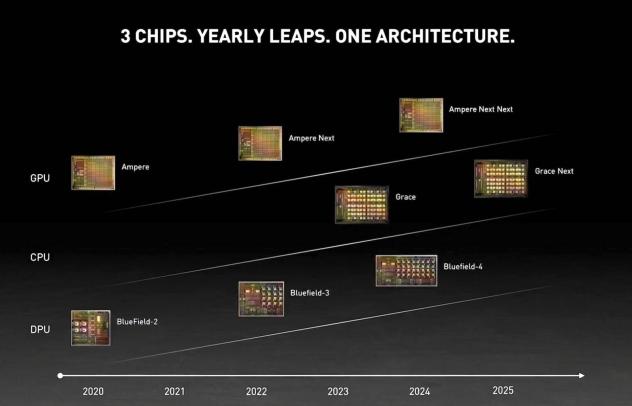

De manière cohérente, NVIDIA veut faire évoluer les gammes GPU, CPU et DPU, tout en mettant à profit le rachat d’ARM et de miser sur les marchés d’avenir.

François Tonic